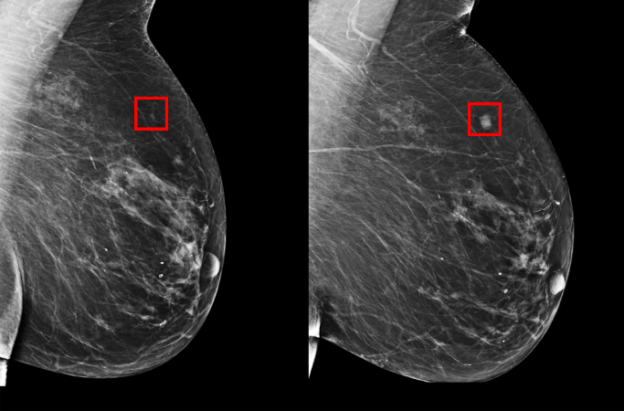

據瞭解,這款深度學習模型接受了超過 9 萬張乳房 X 光照片的訓練,也因此能在 X 光照片中辨識出人類醫生無法辨識出的微小圖案,以目前來說,能夠辨識出 31% 在未來 5 年發展為乳腺癌風險最高的患者。雖然比例聽起來並不高,但與現行醫生可用的任何模型相比(早期階段只能辨識出 18%),結果明顯要好上許多。

研究共同作者 Constance Lehman 表示,自 1960 年代以來,放射科醫生便已經注意到女性乳房 X 光照片上可見的乳房組織有獨特和廣泛變化的模式,而這些模式會受到可以遺傳、荷爾蒙、懷孕、哺乳、飲食、體重減輕或增加等多種因素的影響,一旦能夠運用這些詳細資訊,對個別女性的風險評估將能更加準確。

除此之外,新的 AI 模型還有另一個優勢。由於過去多數評估工具在訓練過程中使用的數據多來自白人群體,因此對非白人患者的評估效果較差,而新 AI 則沒有這項問題。

史丹佛大學醫學院 Allison Kurian 表示,這次的模型最令人驚艷的地方便在於此,與現有的風險評估工具不同,這款 AI 使用在黑人和白人身上表現一樣出色。“如果經過認證且使工具廣泛使用,將可以真正改善我們目前估算風險的策略。”

儘管系統在實用前還需進行廣泛驗證,但深度學習模型可以透過訓練辨認出乳房 X 光照片數據中的模式,而人類靠肉眼並無法做到,隨著訓練數據越大,模型辨認的結果也將更加準確,可想見未來在預測應用上將更為廣泛◆